Autonoom rijden klopt op de deur. De benodigde 'hardware' is er al, nu is het nog zaak alle systemen feilloos te laten samenwerken. Volgens R&D-technici van Daimler en Bosch zit de techniek nog eventjes in de schoolbanken. "Zie het als Aap-Noot-Mies op wielen."

Honderddertig kilometer onder Stuttgart, tegen de Zwitserse grens, bouwt Daimler al jaren aan een compleet nieuw test- en technologiecentrum. Bij het onooglijke stadje Immendingen wordt de mobiliteit van de toekomst beproefd en ontwikkeld. Daarvoor is onder meer een compleet stadswijkje uit de grond gestampt. Autonome auto’s worden er aan alle denkbare verkeerssituaties blootgesteld. “Nee, we laten natuurlijk geen voetgangers en fietsers onverhoeds oversteken. Daar hebben we allerlei simulaties voor ontwikkeld”, stelt een ontwikkelingstechnicus ons gerust.

Tijdens het leerproces hebben auto’s met nieuwe ‘zelfrijdende’ functies kennelijk ook een beetje ruimte nodig. Daarvoor zorgt de ‘Bertha-vlakte’: een plak asfalt van bijna een kilometer lang en 650 meter breed. Bertha staat voor Bereich zum Testen Hochautomatisierter Fahrfunktionen, een wat vergezochte knipoog naar Bertha Benz dus. Aardig weetje: op diezelfde vlakte worden ook op afstand bediende en crashbestendige Targetträgervoertuigen ingezet om gecompliceerde verkeerssituaties na te bootsen zonder bergen auto’s te hoeven afschrijven.

Er valt kennelijk nog veel te leren voordat het Daimler-concern met een gerust hart zelfrijdende productiemodellen de weg op stuurt. Tijdens een workshop over autonoom rijden die we in Immendingen bijwonen, willen de R&D-technici geen jaartal van een eventuele marktintroductie noemen. De eerste plannen voor een praktijktest zijn er al wel. Midden volgend jaar start in een stadscentrum in Silicon Valley in Californië een pilotproject waarbij zelfrijdende auto’s als shuttle dienen. Ze rijden een min of meer afgebakende route met slechts beperkte uitdagingen.

Consumenten kunnen de auto’s via een speciale app oproepen. Samen met partner Bosch is gekozen voor het kunstmatige-intelligentieplatform Drive van Nvidia, momenteel erg populair onder autofabrikanten. Ondanks alle optimistische geluiden brengt Daimler niveau 4-productiemodellen zeer waarschijnlijk pas op zijn vroegst in het begin van het volgende decennium op de markt. Dergelijke auto’s nemen de rijfuncties onder de meeste omstandigheden over, maar zo nu en dan moet de bestuurder het heft nog zelf in handen nemen.

BULLETPROOF TECHNIEK

Werk in uitvoering, dus, maar de grote lijnen van het systeem tekenen zich al wel af. Daimler laat in workshops en tijdens testritten in Immendingen zien hoe de auto een evolutie moet doormaken om zelfrijdende techniek ook in de stad goed te laten functioneren. Alle techniek moet, zoals R&D-‘bedieningstechnicus’ Socher uitlegt, onafhankelijk kunnen werken. “Dat betekent in de praktijk bijvoorbeeld dat er drie accu’s aan boord zijn. Zonder energie werkt immers niets. Valt er een accu uit, dan rijdt de auto rustig naar een veilige stopplek. Vallen er twee uit, dan stopt het voertuig meteen op de weg”, aldus Socher.

Maar wat als er onverhoopt complete sensoren of regelunits uitvallen? “Dan kan bijvoorbeeld het remsysteem de auto volledig stilzetten. Het remsysteem met zijn ESP en rembekrachtiging is dubbel uitgevoerd en datzelfde geldt voor de servolectricbesturing waarin twéé elektronische regelunits en -elektromotoren zitten. De bijbehorende motion control weet hoe dan ook tot op de centimeter precies waar de auto is. Dat kan door het zogenaamde differential gps, het normale satellietnavigatiesignaal plus bakens.” Ingenieurs van Daimler en Bosch werken momenteel koortsachtig aan het bulletproof maken van de techniek. Zelfs als sensoren, computersystemen en de energievoorziening om wat voor reden dan ook compleet uitvallen, moet de auto zichzelf en de inzittenden letterlijk en figuurlijk kunnen redden.

ZELF WAARNEMEN

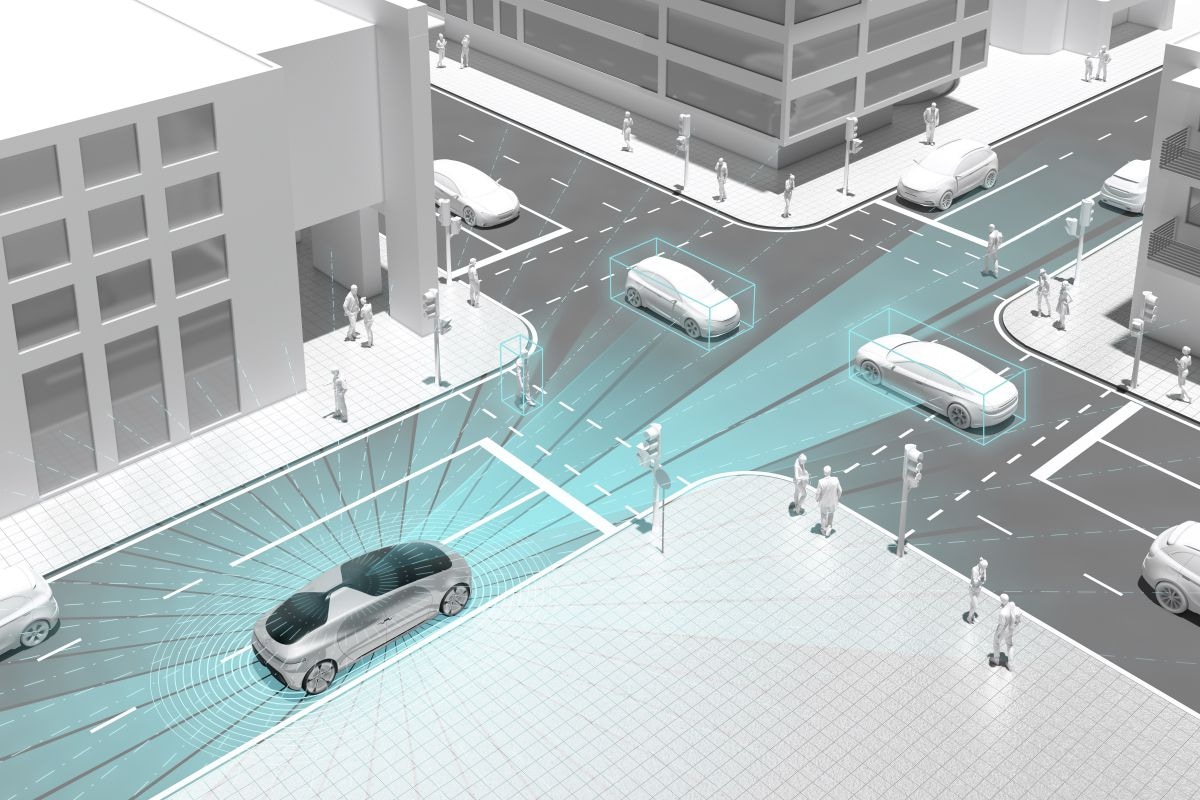

In de afgelopen jaren werd er bij de ontwikkeling van autonoom rijden vaak gesproken over communicatie tussen auto’s onderling, de infrastructuur en over databases met allerhande verkeersinformatie. In Immendingen wordt er met geen woord over gerept. Een gepasseerd station? Sensorspecialist Enzweiler legt uit: “Er is op dit moment te weinig standaardisering. En wie is er verantwoordelijk voor de data? Het kan natuurlijk nuttige extra informatie zijn voor het systeem, en er wordt ook wel aan gewerkt, maar de kern van de zaak is dat de auto zélf waarneemt en vervolgens zijn koers en acties kiest.”

Bij autonoom rijdende auto’s nemen sensoren en kunstmatige intelligentie de rol over van de menselijke zintuigen en het brein. Zelfs ons gehoor krijgt een technologische vervanger. “Naast ultrasoonsensoren voor de korte afstand werken we aan klassieke techniek met microfoontjes. Doelstelling is voor het verkeer belangrijke geluiden te herkennen. Denk aan de sirene van een naderende hulpdienst. Die wil je niet alleen detecteren, je wilt ook vaststellen uit welke richting het geluid komt.”

NIET VAN MENSEN LEREN

Hoe is de actuele stand van zaken rond autonoom rijden? Tesla claimt dat in zijn Autopilot alle hardware al aan boord is om de naam ‘autopiloot’ te rechtvaardigen. In het geval van Tesla gaat het om cameratechniek, in combinatie met ultrasoonsensoren en een radar. De Amerikanen maken volgens de meest recente info ook gebruik van het Nvidia Drive-platform. Daarmee kan het kennelijk toch nog misgaan, zoals de afgelopen maanden bij uiteenlopende incidenten pijnlijk duidelijk werd. Tesla-topman Elon Musk heeft in verschillende media laten optekenen dat het systeem in de loop van de tijd zal leren, ook van andere auto’s. Hij stelt ook dat de beperking van Tesla’s Autopilot vooral in de software zit. Musk maakt diverse keren vergelijkingen met de update van een laptop.

Op de ontwikkelingstestbaan van Daimler leiden de uitspraken van Musk tot opgetrokken wenkbrauwen. Technici willen er desgevraagd slechts kort op reageren. Op de vraag of je wel wilt dat autonome auto’s leren, antwoordt één van de testrijders: “Nee, en al zeker niet van de menselijke bestuurder. Wij als autofabrikanten moeten de auto leren wat hij via de sensoren waarneemt en algoritmen meegeven hoe hij daarmee moet omgaan. Zelf leren kan betekenen dat auto’s uit een vloot van identieke modellen gaandeweg elk verschillend kunnen reageren”, aldus de testrijder. Wel denkt hij dat het met de ‘bestaande’ sensoren mogelijk moet zijn om veilig autonoom te rijden. “We breiden de sensorsystemen, de kunstmatige intelligentie én de bediening – energievoorziening, remmen en besturing – niet voor niets enorm uit om een volgend niveau mogelijk te maken. We kiezen bijvoorbeeld voor stereocameratechniek en lidar, met de mogelijkheid om diepte in te schatten, zoals een mens dat ook kan.”

DRIEDIMENSIONAAL BEELD

Het draait bij de autonoom rijdende prototypen van Mercedes dus om camera’s, radarsystemen, ultrasoondetectie, lidar en geluid. Sinds begin vorig jaar werken Bosch en Daimler samen om alle componenten tot één geheel te smeden. Daarbij is Bosch vooral de specialist van de sensoren. Dat werkt inmiddels aan betaalbare en compacte versies van misschien wel de meest intrigerende component: lidar, in feite een infrarood-laserafstandmeter. Specialist Lehner onderstreept het belang ervan: “Alle sensoren dragen hun steentje bij aan de waarneming van verkeer, bewegingen en objecten rondom de auto.

Ze hebben ook allemaal hun voor- en nadelen, maar het gaat erom dat ze samen optimale informatie vergaren. Noem het een fusie van de sensorgegevens. Aan de hand van de tijd die het gereflecteerde licht onderweg is, ‘weet’ lidar de exacte afstand en richting. Met tienduizenden metingen per seconde bouwt het systeem een driedimensionale puntenwolk op, een uit 1,3 miljoen puntjes opgebouwd ‘beeld’ van de omgeving, inclusief afstanden en de richting waarin iets beweegt. Lidar ziet geen kleuren, maar kan wel het verschil tussen donker en licht waarnemen en zodoende ook op grote afstand verkeersborden lezen.”

LEERPROCES

Met die miljoenen puntjes weet de techniek waar alle objecten zijn, maar dat is nog maar het begin. Het systeem moet leren wat het waarneemt. De ontwikkelingstechnici van R&D vergelijken het met een kind dat naar school gaat. Het roept in hun ogen gelijkenissen op met het oeroude aap-nootmies-bord dat in een grijs verleden op de basisscholen werd gebruikt. “De lidar ziet dat er op 13,4 meter iets staat, tot op de centimeter nauwkeurig. Maar wat is het nu precies? Daarvoor gebruiken we ‘deep learning’. Tijdens de ontwikkeling wijzen we in het opgebouwde 3D-beeld letterlijk objecten aan en zeggen wat dat precies is, plaatje voor plaatje aanvankelijk. Monnikenwerk.” Zo hebben verschillende landen ook hun eigen wegmarkering, verkeersborden en kleuren van een politieauto. Daarvoor gaat de techniek dus in de schoolbanken.

Alle afzonderlijke sensoren krijgen overigens hun eigen deep learning-‘training’. Samen vormt dat de best mogelijk informatiebasis. Alle informatie wordt in elkaar geweven. Dat klinkt echter gemakkelijker dan het is, zegt Lehner. “Je wilt alle bronnen in de juiste tijdvolgorde synchroon samenbrengen, maar ze werken allemaal in een verschillend tempo. Zo geeft de stereocamera twintig beelden per seconde, lidar en radar ontelbaar veel meer. Bovendien zitten de sensoren niet op dezelfde plek en kijken ze ook nog verschillende kanten op. Wat je uiteindelijk wilt bewerkstelligen, is het samenballen van de data.” De technici omschrijven het zo: de auto moet ‘leren’ om uit de geometrische informatie – zeg maar een driedimensionale puntjeswolk en plaatjes – zogenaamde betekenisvolle informatie te halen.

Wat is het? Hoe beweegt het? Je kunt er immers alleen wat mee als er ‘betekenis’ aan het 3D-beeld is gegeven. “Deep learning klinkt hightech, maar is eigenlijk precies wat de naam zegt: een uitgebreid leerproces waarmee de techniek zin kan geven aan wat de sensoren waarnemen. Systemen die je kunt vergelijken met het brein, gebruiken dat om te bepalen wat er moet gebeuren. Op het beeldscherm in onze testauto’s zie je die objectherkenning naar kleuren vertaald, zodat je als mens beter begrijpt hoe het werkt. Een auto is blauw, een fiets rood, voetgangers hebben weer een andere kleur. Zo hebben ook de rijbaan, het trottoir, bomen, verkeersborden en allerlei andere objecten, zoals een rollende bal, een eigen categorie.”

BETERE HERKENNINGSTECHNIEK

Je zou denken dat er in autonoom rijdende auto’s supercomputers zitten, maar in feite gaat het overwegend om razendsnelle en slimme versies van GPU, oftewel gamecomputertechniek. Grafische processoren dus. Waarom zijn er dan verschillende sensorsystemen nodig? “Onze uiteindelijke doelstelling is dat elk beeldpuntje rondom de auto wordt begrepen”, aldus cameraherkenningsspecialist Jascha. “Daarvoor wordt de herkenningstechniek gaandeweg verbeterd en werkt het allemaal steeds sneller. Er zijn grote uitdagingen, zoals het ‘onbekende’ object. Denk aan een verloren lading op de snelweg.

Het systeem mag de auto er niet overheen laten rijden, maar juist wél over schilderingen op de weg die er misschien veel op lijken. De techniek moet ook omgaan met zeer beweeglijke verkeersdeelnemers als scooters, fietsers en vooral voetgangers. Vooral die laatste twee kunnen er chaotisch uitzien. In het totaalplaatje van het systeem heeft elk object een eigen nummer. Ook door elkaar lopende voetgangers worden gevolgd, ongeacht hun aantal. Indien nodig – omdat ze uit beeld lopen, bijvoorbeeld – worden ze overgedragen aan een andere sensor. Je wilt immers zeker weten dat er niet één van hen voor je wielen loopt.”

SCHERPER DAN EEN MENS

Het is glashelder: een autonoom rijdende auto mag nooit ofte nimmer één van die bewegende objecten uit het oog verliezen. Ook niet bij tegenlicht, zware regenval of sneeuw. Vooralsnog maakt de techniek ‘de mens’ met boter en suiker in, zo merken we tijdens de testritten op het centrum. Op het beeldscherm verschijnt extreem ver weg de kleur van een mens, grotendeels verscholen achter een auto. Die hadden we met het blote oog dus nooit opgemerkt. Ook signaleert de auto voetgangers die kennelijk het plan hebben om over te steken. “We werken er nog aan dat hij ook herkent wanneer ze nog even staan te praten en de auto doorzwaaien”, meldt een Daimler-technicus gortdroog. Het is duidelijk: de autonome auto is het aap-noot-mies-stadium al bijna ontgroeid en mag spoedig op voor het examen. Daimler kennende zal de kandidaat met vlag en wimpel slagen. Over een paar jaar gaan we het daadwerkelijk aan den lijve ondervinden.

Dit artikel is gratis te downloaden in PDF-formaat. Hiervoor maak je eenmalig een AutoWeek account aan, waarna je onbeperkt uit het AutoWeek archief kunt downloaden.